当前位置:首页 > 企业查询 > 北京信必优信息技术有限公司 > 产品服务 >

信必优人工智能 – 终结灵感还是启发更多思考?

反思人工智能的进化:机器是如何超越人类能力的。

无论您的背景如何,您可能都想知道人工智能是什么,它如何影响您的工作、业务或社会。这是一个沉重的话题。

人工智能对社会经济产生的影响日益成为公众讨论的焦点。今年夏天,亨利·基辛格对这个话题进行了反思,揭开了一场热烈讨论的序幕。在《大西洋》2018年6月刊中,美国政治家、前美国国务卿基辛格先生对人工智能做出了非常精彩的论述。他着重强调了他的担忧,认为我们毫无准备,而启蒙时代即将结束。

人们可以看到,同样的恐惧和警告在夏天重复发生并得到进一步阐述。在一本出版物中,表达了AI可能使思维变得无关紧要的观点。另一份出版物关注的则是 AI 是否以及如何*终结束民主。

在您详细阅读之前,我分享一下我的观点吧:很多公众讨论都是基于今天的能力广泛的推断不久的将来。由于许多作者*终做到了将算法人性化,因此这些推断很容易这一观点。所以,这些说法可能都很好的表述了事实,但并没有良好的判断基础。

类似的,许多人同样将 AI 视为某个领域的单一产物。但事实并不是这样。更糟糕的是,您的其他信息可能来源于提供 AI 产品或服务的组织的营销部门。

事实上,正是这次公开讨论促使我写了这篇文章。当您注意到,您已经开始为机器赋予人类特征,您可能不会开启启蒙之旅。

要从技术的潜能中受益,您*好先努力理解它。我会尽力帮助您了解什么是 AI。我会让您自己得出进一步的结论。

我们首先了解 AI 的定义(有点无聊?)

从非正式定义角度,人们可能会说人工智能是机器表现出来的智慧,或机器模仿与我们人类相关的“认知”功能。它可能涉及玩战略游戏、自然语言处理、车辆驾驶等主题。

这个定义可能令人惊讶的一点,就是它隐含时间限制。1990 年或 2000 年人工智能传递的内容都已经不再符合今天的宣传,因为它已经变得司空见惯。我们不会把 OCR(光学字符识别)当作 AI。即使它搭载了深度学习和 TensorFlow 也不例外。

一旦我们熟悉某项新技术后,就不再认为它需要人类认知。该领域的人甚至创造了 AI 效应一词:“AI 就是我们尚未完成的一切。”

如果您查找更科学的定义,您的教材(或维基百科)可能会将其称为智能代理研究。如果您的教材较新,可能会将其解释为理性智能代理。这样的智能代理可以是任何实体,或者说是一个能够感知其环境,并采取行动使其在某个目标上的成功*大化的设备。这样的智能代理可能能够学习,机器学习 (c. 1959) 随之诞生。他们可能能够利用先验知识,知识表示和推理随之诞生。或者其他能力 – 我们稍后会细细讲到。

经过一番思考后,您可能会注意到上述更科学的定义实际上相当广泛。也理应如此。您不希望基于特定方法或单一方法定义研究区域。更明智的做法是从研究目标出发,创造具有理性行为的智能代理。

无论如何,一个简单的反射智能代理 – 比方说一个自动水龙头 – 就符合这个定义。它现在不是*技术,但它曾经是。

这就使得“人工智能”这个词听起来有点模糊?

我们对人工智能的非正式定义是,几乎没有任何东西符合标准,而更正式的描述似乎又认同几乎所有东西都可以称得上是人工智能。

当然,人们可以使用当前的*技术,并列出您认为属于 AI 方法的清单。遗憾的是,这可能并不会加深我们的理解(这只是一个清单)。此外,该清单依然存在时间限制。当前的*技术在未来数年内可能就过时了。

AI 不是一个单纯的概念

AI 绝不是一个单纯的概念。字面来看:AI 并不是单纯的超级智能大型机。

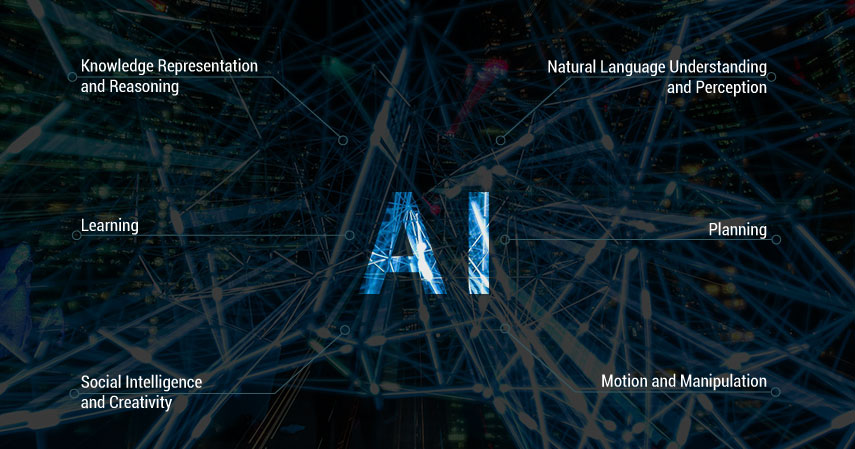

它还存在更进一步的阐释。您可能不会将 AI 视为单个研究领域或特定方法。实际上,AI 领域吸纳了许多广泛的研究领域,*突出的是数学和计算机科学。许多方法来自其他更深入的研究领域,如心理学、语言学和经济学或者神经科学等。

是的,生物神经系统学科为人工神经网络提供了灵感。而如果将这些学科网络与灵长类大脑进行比较,就会发现二者在结构和功能属性上存在清晰、明显的差异。

继续列出研究领域可能也不会增加我们的理解。*好的办法应该是观察可能应用 AI 的不同目标,以及在研究人员和工程师心中 AI 所具备的能力。

推理与规划

仔细审视 AI 的目标,建立能够推理和解决问题的机器可能是其首要任务。可以说,这二者都有所裨益。如果您能够使用先验知识,它们也将更容易实现,因此应包括知识表示方法。如果您的机器能够执行部分活动,规划功能将非常有用。我们还没有实现学习功能,但我们将需要从博弈论、概率论或决策理论等广泛的学科中汲取经验。也许您需要贝叶斯网络或进化算法来满足您的目标。当前已经存在广泛的方法,其中许多方法已经过试验和测试。

学习

从经验中学习也可能对我们的智能代理非常有益。实际上,过去几年,机器学习发展非常迅速。换言之,这是一切模糊的源头。公众和学术界都在谈论深度学习。也就是说,机器学习具有多层非线性处理单元的级联,通常采用人工神经网络的形式。“深度”意味着除了输入和输出层之外,还有不止一个处理层。

您可将此类网络视为一种具有高度表达能力的函数,可将其应用于表示复杂非线性现象。训练部分实际上是一种优化问题 – 您希望*小化网络产生的输出与期望结果之间的误差。

如果您拥有相关知识,就能够选择结构合适的学习任务以及与之匹配的合适的网络构架。此外,如果您拥有合理、数量可观的训练数据(正确的输入和输出数据集),即使对于之前未见过的输入,您的网络也可学会产生正确的结果。

人们可能将这种能力描述为“习得”,以与“推理”进行区分。网络能够学会习得您训练的任何项目或概念。我们后续再详细讨论。

自然语言理解与感知

事实证明,学习可广泛用于诸多其他功能方面,例如,自然语言理解或感知。

有趣的是,许多机器视觉问题可能比将人类语音转换为文本更为容易。结构更简单的前馈网络(信息传播到网络中的一个方向,即前馈)可能能够学习对图像进行分类。先进的语音识别工具则通常基于所谓的递归神经网络(网络也将信息反馈回其自身)。

要理解单词或句子,则需要重复这种情况。您可以将其视为一种具有短期记忆的算法,由于能够提供更多输入(音节、单词),因而可以更准确地识别正确的单词。事实上,在将语音转录到文本方面,机器比我们做得更好。

机动性与自主操控

机动性与自主操控功能也可能对智能代理有所助益。它们也是机器人领域的关键目标。它可能是触觉智能或随机路线图,也可能包括机器人映射。

传统上,机器人领域可能与机器学习的关系不大。从控制理论和其他领域借鉴的方法更加成效。您可以使用这样的方法来创建一个即便在崎岖地形中行走也不会跌倒的机器人。换句话说,您在 YouTube 上看到的机器狗视频可能与机器学习关联不大,它更多是在需要时启动的预编程算法。

但有一个领域叫做策略学习。在这个语境下,它不是指政治领导人或公职官员。而是说,我们希望我们的智能代理能够学习一种*佳策略,使其能够在复杂的动态环境中实现其性能*大化。

强化学习、尤其是 Q 学习等机械学习方法可能适用于这种情况。Q 学习中的智慧是使用一个深层神经网络来近似得到一个所谓的 Q 函数。这个 Q 函数的预期目的是在给定环境的感知状态情况下评估特定动作的效用值。如果您已对该 Q 函数已实现充分逼近,则只需要能够生成所有可能的下一个动作。

要构建一个能够学习的更复杂的机器人,我们可以使用某种策略学习作为控制机器人动作的更高层次。这将有助于机器人针对不同的场景更好地学习动作。然后我们可能会使用其他技术来执行这些操作,例如“向前迈出一步,不要跌倒”。这些功能都非常复杂,需要大量不同的组件协同工作。

顺便一提,如果您尝试与合适的机器人研究人员谈论机器人过程自动化,并且您的机器人没有考虑物理方面,他或她会对您嗤之以鼻。关键的挑战通常就在于其物理方面 – 如何感知或如何操纵现实世界。不可否认,更复杂的业务流程的自动化也可能涉及许多研究领域,并利用复杂的机器学习模型。

社会认知和创造力

人们仍然会提到一些目前非常明显的目标,例如创造出具有社会认知和创造力的机器。

几十年来,我们已经拥有了能够为数学定理提供坚实证明的算法。这些证据可能是坚实的,但通常不够简单、有效 – 也许不是很有创意,存在相当多的试验和错误。

今天更突出的技术是各种推荐引擎,它们使用机器学习向我们推荐新产品和服务。聊天 AI 平台旨在提供实现简单对话的工具,例如理解人类情绪或对行为分类。甚至还有一个专门的计算设计领域 – 该领域的工具可用于创建复杂的图形用户界面。

当然,我们也看到过一些方法,比如生成对抗网络,这些方法可用于创建逼真的虚假名人面孔。而更重要的是,类似方法在欺骗其他机器学习模型(例如用于分类图像的模型)方面非常有效。

例如,考虑一下用于处理保险索赔或金融交易的 AI 工具。如果您的 AI 应用程序容易受到对抗性攻击并且收益/风险比较高,那么您可能需要仔细考虑如何检测这些攻击。它看起来是一个难以攻坚的难题。

初步结论

我们考虑的重点是,构建 AI 系统存在各种不同的方法,如果您希望为现实生活环境创建新的复杂应用程序,就需要研究人员和工程师团队对这些方法进行精心组合。它不是偶然的。

同时,您还务必要了解到,当前许多相当通用的功能直接适用于您的问题。如果现有方法与您的目标完全匹配,可以直接将其应用到组织的环境中。问题在于您是否熟悉当今可用的各种潜能 – 这是快速发展领域的一大挑战。

机器在围棋、DOTA 方面都打败了我们…

基辛格先生和许多其他作家的论点是,算法已经在很多领域打败了人类,比如围棋游戏或者多人视频游戏(基辛格先生提及了围棋,而未说起 DOTA)。

这里似乎存在某种的紧急行为,另一方面,似乎没有什么能阻止这些机器更快地学习。因此,它们将很快在所有人类冒险中超越并战胜我们,而我们在世界上的角色将逐渐减弱,直至相对无关紧要。

诚然,AI *近取得的成就非常惊人。由于目前的成绩,人类很容易开启技术人性化研究。但是,这可能无法提高近期功能的外延质量。

如果您询问这个领域的*研究人员,就会得知我们距离机器在日常工作方面远超人类还有很长一段距离。

为进一步理解,我们首先考虑一下智能代理未来的运行环境。这些环境的复杂性可能会极大地影响智能代理需要的复杂程度。

复杂还是简单环境?

Russell 和 Norvig(人工智能 – 现代方法,2009)提出了一种对此类环境进行分类的模型。例如,环境是否具有确定性 – 智能代理是否可以根据它将选择的操作完全预测环境的下一个状态?

它是否是静态的 – 即智能代理考虑下一个行动时环境是否会发生变化?智能代理能否完整观察此环境?此环境中存在多少智能代理?此环境中是否存在隐藏规则?您是否需要记住过去的动作?它是离散的(更容易)还是连续性的(更难)?

您猜对了:虽然围棋是一款了不起的游戏,简单的规则衍生出极端的复杂性;但作为 AI 系统需要掌握的环境,它几乎符合所有的条件。

不可否认,围棋是一个多智能代理环境(AI 玩家及其对手),但是它在轮流执子之间不会发生随机事件,它是离散的,没有任何隐藏规则,环境则完全可以观察。

*后,这个游戏无需记忆移动的步骤,因为当前的游戏状态为您提供了所有的必要信息,可以确定*佳下一步行作。如果是一个大师或 AlphaGo 的某种变种,都可以做到这一点。

简而言之,您可能会认为 AlphaGo 是一种穷举方法。AlphaGo用穷举来实践和学习更多的人类选择的可能性,而不是使用穷举来计算人能力范围之内的动作。换句话说,在这个相对单纯的环境中,机器学习算法能够比人类更好地评估可能出现的下一步动作。

快速还是慢速思考?

Daniel Kahneman 的系统 1 和系统 2 思维模型为我们提供了更多有趣的观点(《思考,快与慢》(Thinking, Fast and Slow),2011)。提醒一下,Kahneman 凭借在行为经济学方面的成就荣获 2002 年的诺贝尔奖。

在 Kahneman 的著作中,系统 1 指的是快速、本能和情感思维,而系统 2 则是缓慢、更加慎重的逻辑思维。当然,有人会质疑这是否代表所有人类认知的有效模型,但 Kahneman 的方法确实有其优点。它还为我们提供了一个简单的框架,让我们考虑当今可用的机器学习能力。

现代的机器学习系统更注重识别而非推理。也就是说他们专注于系统 1 的思维。例如,机器学习模型可以准确识别游戏中可能出现的下一步动作。它将根据过去学到的知识来实现。但是,它不会进行推理或系统 2 思维。所有工作重点在于培训 – 应用此模型后,智能代理只需直接识别。

换句话说,如果环境没有提供良好的学习机会,或者如果没有预先存在的数据集来帮助识别正确的策略,我们的智能代理将会不知所措。

系统 2 思维在 AI 领域并非全新概念。想想几十年前,专家系统曾是多项研究的重点。实际上,有些人希望此类系统能够为办公室的高度自动化铺平道路。而事实证明,部署此类系统需要大量的人类工程学。

推断近期活动功能

现在可能更容易看出推断错误是如何发生的。事实上,我们能够创建一个基于识别的 AI 系统,在狭窄、有限的环境中赢得人类;但这并非意味着我们能够将它与其他类型的思维相结合起来,部署到更复杂的环境中,并使其仍然与人类能力相匹配。

当然,我们人类正在挑战极限。我们希望在不久的将来看到自动驾驶汽车在比围棋游戏更复杂的环境中运行。这是一个整个巨大的工程和研究挑战,需要所有行业共同应对。由于其高价值和随之而来的高投资,我们正在相对复杂的现实生活环境中推进这个单一任务的自动化进程。

我们还希望整合学习过程和学习路径规划,或识别和推理等功能。换句话说,构建出能够有意义地整合系统 1 和系统 2 思维的系统和模型。

然而,这可能比建造自动驾驶汽车更加困难。我们需要循序渐进。

我现在该怎么办?

目前,我们还没有具备人类思维层面的 AI 系统。我们离这个目标还相差甚远。可以说,我们只是比 AI 领域诞生之时更近了一步。可以断言,路漫漫其修远兮,充满了各种未知的坎坷险阻。

我们*拥有的,是在特定环境和任务中超越人类能力的机器和算法。这本身并不是新闻,但在过去几年中,这些环境的范围和任务的范围都在迅速增长。我们拥有大量的机会,可以利用这些技术来改善我们的工作和休闲。

尽管前沿技术开发前路曲折,但一旦它出现,后续可能非常容易应用。解决一个您认为不可自动化的问题,或者可能难以应付的问题,只需要短短几周的时间。

关键在于确定哪些可以自动化,哪些则需要动用人类动力。还记得您的老板*次提及“二八原则”吗?如果将这些算法和机器用于大部分工作,并将其与人工监督结合起来,用于更有趣的案例,就会取得更有成效的成果。让机器学习模型完美运行并非易事,但要找准大部分则相对简单。

机器和算法能够以更高的速度和质量处理高度重复的任务。它们还可以进行人类无法做到的大规模数据处理。拥有合适技能的合适人选可毫不费劲地完成大部分任务。

需要将创意与经验结合?存在歧义,没有先例?轮到我们大施拳脚了。

我们关注的并非机器已经取得优势的领域。问题在于如何将人类工作和机器能力结合起来。

更多思考 – 不是启蒙的终结!

与许多人的担忧相反,我相信,用人类自己的头脑思考在未来会变得更加重要,而不是相反。另外,这个结论适用于所有类型的工作和社会各个层面 – 而非仅适用于能够建立和利用*优势的少数人。

理由林林总总,我们也在上方讨论了许多。仔细想想吧。

制作软件副本成本很低。计算的成本越来越低,效率越来越高。我们可以将软件应用到越来越多的繁琐、无聊的海量任务中。我们正在大幅提高生产力,而不会增加环境负担。

此外,我们仍然需要人为监督,甚至需要更多人为监督,因为我们的技术仍然无法做到很多对我们来说非常基础的事情。

这并不是启蒙的终结。相反,我们可将更多的时间专注于我们喜欢的事情,以及对我们来说真正重要的事情。